【原文刊登於知乎,作者荆慢慢,蘋果仁授權轉載】

平時對蘋果的攝影功能總是表示淡定,因為底大一級壓死人,無論怎麼吹捧,它能做的,相機都能做得更好。

但今天無意瞄到iPhoneX的新特性Portrait lighting時,我心臟驟然停了一瞬——我彷佛聽到它用一種頗具說服力的姿態告訴我們:手機的相機不再是數位相機的附庸:從前,它能的,數位相機一定更好。而現在,它能的,數位相機幾乎不能。此後在拍照同時,手機將前所未有地記錄人臉的精細三維結構,因此新iPhone不再像過去那樣只是比較方便而已,至少在自拍方面,它是一個真·攝影棚。

原因一言以蔽之:多了一個維度的資訊,產生高維碾壓。

Portrait lighting中文名叫“人像光效”,聽起來就像美圖秀秀裡的”一鍵美白“:

若真當它是美圖秀秀或者某種濾鏡,你根本無法意識到它會產生多大的威力。它目前還是beta版,我今天說的,是它四五年後的一點小小可能。本文談的,是它新硬體帶來的未來。

它的作用是給你打光,假裝你處在不同佈光的環境下,比如攝影棚、舞檯燈。

光永遠是最重要的,這前所未有的效果讓美圖一眾在它面前都成了名副其實的垃圾。因為它結合了面部結構資訊。

在未來,你完全可以隨意拍攝一張自拍,然後拖出“經典三盞燈”,把自己照得跟蒙娜麗莎一樣古典,發給男神:

然後轉頭換出一盞底燈,發給膽小的閨蜜。

在未來,你修自拍時,首先做的不是瘦臉磨皮,而是仔仔細細調節手機裡虛擬燈光的參數,免得被人說不專業。

利用它,網紅還能在直播中由手機自動後期,效果極其自然,再也不怕見光死。

至於畫質?對自拍狂而言,光線好的叫畫質,不好的叫貼圖。

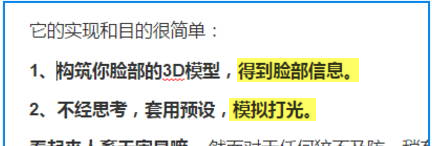

回到Portrait lighting,它的實現原理特別明確,它產生區分度的核心在構築臉部3D模型。

1、構築你臉部的3D模型,得到臉部資訊。

2、套用預設,模擬打光。

基於此,光線的模擬對自拍的提升幾乎是工業革命般的,甚至能將近景的廣角人像提升到專業攝影都不一定望其項背的程度。

對於任何猝不及防的“人像攝影師”而言,都必會震撼於這個新生兒前途無限的未來。而如果他們還能聯想到一點人工智能的偉大,他們一定會肅穆,敬畏,乃至恐懼。

一、不知者無畏

若想一窺攝影師這種恐懼,需要從棚拍這件事情說起。

棚拍是自拍的極致 ——燈光師給你佈置最佳的光源,去掉干擾物,構成不再業餘的照片。

棚拍和日常拍無非光線的區別而已。對人像而言,攝影棚下的光線都是為了更強地塑造模特的面容而存在的,與日常唯一的不同在於,它的每一根光線都是帶著目的,你的下巴會更瘦削,鼻樑會更加高聳,雙頰細膩的影子有著迷人的過渡。

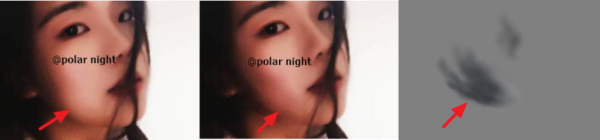

拍攝後,在後期處理中調整不夠整齊的光線:

美醜之間只是光線的區別而已,這些對光線的改動形成了調整層,讓圖片看起來更加均勻,可以灰色圖片的形式記錄:(灰色對應無改、深色對應變暗、亮色的部位變亮↓)

這個增減光線的過程非常耗費時間 ——甚至可能持續24個小時。還需修圖師對妝面和燈光效果能充分理解。

在後期工作時,你必會需要彌補人臉的種種不足——比如下圖,為了彌補姑娘過寬的面頰,將箭頭處光線減弱,營造出影子(此處並非液化)。

後期整理結束,攝影師的主幹工作就算完成了。

二、攝影師的作用

我們再一琢磨,這個給我拍照的師傅最大的功能無非就是排個光罷嘛:

——前期擺燈看起來高大上,目的是為了臉上的光;

——後面PS看起來費力,目的還是為了臉上的光。

比如上圖臉頰的寬度,模特的皮膚的整齊度,實際上僅僅是光線的區別 ——過暗的地方如唇部要補光,過亮的地方減光。

既然只需增減,為何不能讓電腦一步調整到位呢?

因為電腦只看到你的平面圖—— 它不知道你鼻子多高眼睛多深,自然也不知道該怎麼給你打光。如果它看到的是立體的,自然就知道了。

現在,新iPhone就知道了。

我們會發現,攝影師除了打出“ 真實燈光”和“審美思考”之外,剩下的工作已經可以被手機接管了。手機終於知道你的眉眼多深,自然能幫你完成大體的調整工作。

這種因為智能產生的接管,在我看來正是傳統攝影和手機自拍之間真正開始產生區分度的地方。

專業拍臉的核心流程無非如此:

1、肉眼識別,得到臉部資訊(深淺)。

2、經過師傅的思考,用燈光打光,再用PS對瑕疵模擬打光。

將其與Portrait lighting的流程進行一番比較,會發現流程核心一致:

——過往無論”柔光雙攝“還是”美顏神器“,無非是後期流程的粗糙歸納。傳統自拍中,因為計算機無法感知立體資訊,精細活需要手工處理。而現在計算機感知到了,便自然地將計算機澎湃的生產力正式引入手動工序——這正是工業革命。

這樣的改變對整個手機的影響僅次於電容螢幕的出現,本文僅談論自和攝影層面:手機現在能幹相機不能幹的事情了。

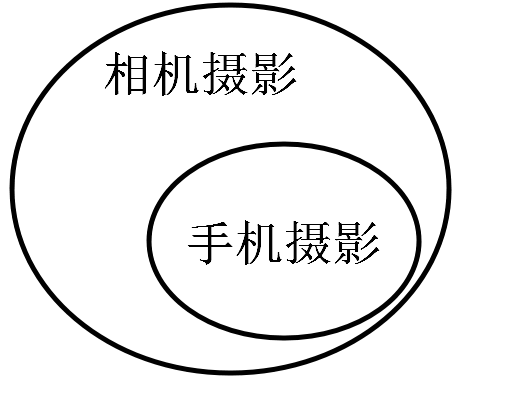

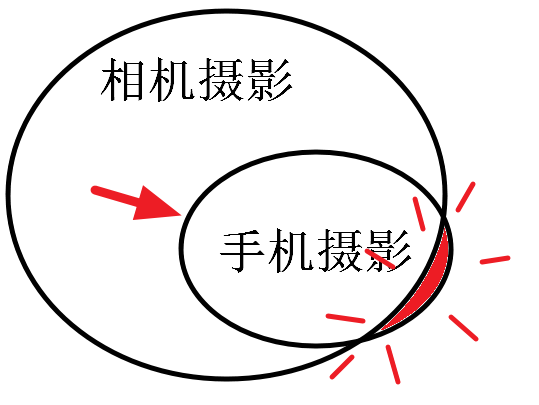

如果過往手機攝影和相機攝影的關係是這樣的話:

那麼今晚的iPhone,成功地將他們之間的關係稍微移動了一點點。

然而這樣的一點是多麼顛覆,多麼具有開創性,是突破了”手機能幹的事情小相機也能幹 “的魔咒的一點。

現在新的傳感器已經能直接獲得臉部的立體造型了,便能粗糙取代修圖師手動的加深減淡,我們要做的,就是調整自己喜歡的光線,無論美食還是微距還是自拍,我們都能像拿手電筒打光那麼簡單地照射出好的效果!!

理論上,我們能想像到的任何光線,都能在iPhone上轉眼得到實現!

三、當然,有人肯定嗤之以鼻,會認為前期佈光是無法代替的。

然而前期佈光當然可以代替啊,不然3D動畫怎麼來的?只是精度問題罷了。

舉個例子,如果我把下圖這張jpg發給修圖師,為了提升此時的光影,對方需要用PS一點點修飾明暗。

但如果由我發了原3D文件給他,他只調整模擬燈光的位置,便能得到遠超之前修圖師的理想的效果。這就是佈光可被取代理由,有深度資訊,就可以計算。

(上圖並非實拍)

它就像像一個在燈光和光影之間的函數,代入左邊,就能得到右邊。

綜上,新的iPhone卻在自拍時保存了三維的”模型“資訊,那麼只要IOS允許,自然就能隨意打光。而且遠比人工來得自然。(←此處留個噴點)

一次不太成功的人肉補光