你的圖片莫名被臉書刪除了嗎?臉書誤判你的照片是色情圖片嗎?其實除了透過機器人快速篩選外,各大網路公司也都有為數不少的「內容審查員」,每天就是負責看各個平台上最黑暗、不堪入目的內容,然後刪除,為大家把關。

這份神祕但辛苦的工作到底是甚麼?本篇來為你揭曉

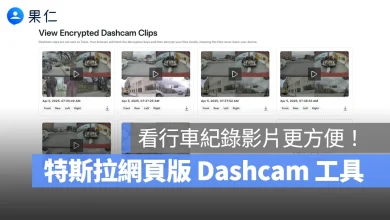

在柏林一個不起眼的辦公室裡,600 名員工如冰冷的機器一般,目不轉睛地盯著螢幕,拿著一個滑鼠頻頻點擊,卻做著影響全球20 億人的事情:

網上每天超過一百種語言的數十億貼文,哪些可以放出?哪些需要保留?哪些需要立刻刪掉?

他們是Facebook 的內容審查員們,幾乎每10 秒就要做出一個決定。

▲Vice 實探Facebook 的審核員工作環境. 圖片來自:MAX HOPPENSTEDT

▲Vice 實探Facebook 的審核員工作環境. 圖片來自:MAX HOPPENSTEDT

這個群體,大部分其實並不了解。他們不在深不可測的暗網,也並非和網友近在咫尺,但近月加州大學教授Sarah T. Roberts出了一本新書《螢幕背後》講到:

社群網站上最陰暗的一面,不在廣大網友的的螢幕裡,而在內容審核員眼前。

▲ 圖片來自:《網路清道夫》截圖

1 天審查25000 條內容背後

你好,你發表的***,因為含有違反相關法律法規或管理規定的內容,已被移除。

當你發在臉書上的內容無法通過審查或突然被刪除時,就是內容審核員在工作了。

在早期,網路還是一片分散的網路,連接數十億個網站和社群的人們,隨著網路越來越「公司化」,Facebook,YouTube,Instagram…… 內容審核員開始出現,用來監管它們各自的網站。

所以簡單來說,內容審核員就是將網上涉嫌違規的內容刪掉的人。不過它帶給人們的第一印象,一般都是「色情守門員」。

「色情守門」沒錯,但只是工作內容的一部分,儘管很多人還認為這是一種額外福利,但它並沒人們想像的那麼簡單。

在一部《網路清道夫》的紀錄片中,Facebook的內容審核員一天的處理指標是25,000個。而這些內容中遍地都是兒童色情、恐怖主義、自殘虐殺、極端組織言論…….他們的職責,是把最骯髒和噁心的資訊阻隔在我們可以看到的世界之外。

刺激、壓抑、憤怒、冷漠、道德譴責…… 各種情緒混雜,不斷刷新感官、挑戰忍耐極限。每個人從不斷累積的趕快刺激,慢慢變成習慣後的麻木。

▲ 圖片來自:《網路清道夫》

而據國內某網路企業的員工敘述,他們的日常工作,除了會出現一些極端的情況,大部分時間可以說是反覆甚至有些枯燥的:

單一的工作環境。

盯著螢幕一整天,白天黑夜紊亂。

從成千上萬的自拍照、度假照、惡俗影片裡,重點搜尋涉黃和涉政,還有一小部分賭博、高利貸、賣槍賣藥的貼文。

刪除,再看,再刪除,再看。

▲雖然是著名的越戰照片,但也會也因為「捍衛未成年人的裸照」而被刪除

另外,他們的平均薪水高於最低工資。內容審核規則十分模糊,且經常變化,大部分靠既定模型和長期經驗中把握尺度,但有時候看上頭命令,有時候看上司命令。每個月都有人來,有人走,公司從來不留人。

2017年一樁Facebook的集體訴訟案中,數千名內容審核員表示在工作中受到了嚴重的心理傷害,導致發生創傷後應激障礙,「睡眠中一點響動都會讓我有遭遇車禍的錯覺」 。

但這又是一份不可或缺,至關重要的工作:網路清道夫,就是網路內容的把關者,如果他們不清理違禁內容,不阻擋那些非法資訊,就會有更多青少年和小孩看到。

Google、Facebook這些大公司非常重視它們,現在已經幾乎讓數十萬人任職,雖然它們也為審核員提供了心理健康諮詢和檢查,但也依然承認,內容審核員是科技界最具心理創傷的工作之一。

那這份「悲傷職業」,有沒有可能用更好的方式去解決,甚至,人類可以不再做這類工作?

無法消失的內容審核員

事實上,目前的內容審核只能是人來進行的——貓捉老鼠的遊戲。

隨著網路公司審核員投訴和抗議事件屢發,再加上網路用戶上傳內容量增加,頭部平台每天產生的UGC 內容量更是天文數字,人力投入昂貴且難以擴展,所以現在幾乎所有公司,都已經在用「人+機器」的內容審核方式。

▲ 雅虎開源過一套深度學習神經網路,能給圖片評估一個NSFW(Not Suitable/Safe For Work)值,最無害的是0,最極端是 1

國內最早利用AI 技術從事內容審核服務的圖普科技,據說現在對於色情、暴恐、低俗、詐騙等內容已經能達到99% 的辨識率,降低90% 以上的人工審核成本。

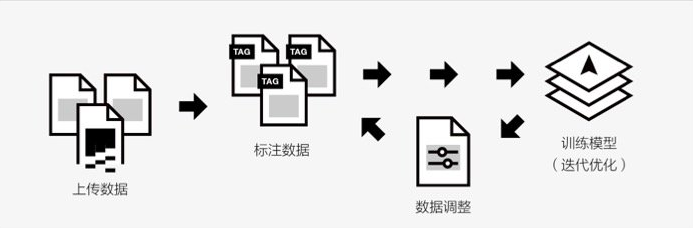

在人機結合的審核裡,首先AI 會進行第一階段海量內容的審核,區分正常內容、確定的不良內容以及不明確的內容,然後貼文被分類分配出來,再由審核員對「不明確的內容」進行人工複審。

這樣一來,AI 能夠幫內容審核員減輕負擔,讓他們更效率更高地去做決策,專注於數據分析。

但要讓人工智慧取代人力,現在依然像是天方夜譚。

雖然AI 技術發展越來越快,但是因為自然語言處理(NLP)的難度,機器在理解語言上,還不能達到人類的思維程度,所以審核文字也會失誤,更何況是圖片、音樂、影片。

深度學習的局限性在於,如果要創建準確檢測成人內容的神經網路,則必須先讓AI在數百萬個帶註釋的成人內容來訓練。沒有高質量的培訓數據,AI就很容易犯下錯誤。

▲ 圖片來自:《網路清道夫》截圖

AI擅長辨識色情、垃圾郵件和虛假帳戶,但因為審核量太大,類目很多,邊界模糊,就像女性母乳喂養、月經藝術、戰爭暴行,也會被誤認為違禁內容,被AI辨識挑選出的違禁圖片裡,還有數不盡的加菲貓,因為有它的畫面裡,幾乎都是黃色。

畢竟機器是人「餵」出來的,

比如仇恨言論和騷擾方面,它辨識的準確率就很差,Facebook 認為它們可能需要5 到10 年的時間才能開發出可以發現仇恨言論的AI。

▲ 圖片來自:MICHELLE THOMPSON

圖普科技CEO 李明強在接受愛範兒採訪時也表示:

不得不承認的一個事實是,現階段AI 還處於弱人工智能階段,只有將來AI 具備自主學習、獨立思考的能力,達到人類的理性和感性判斷,也就是強人工智能階段,那時才有取代人力的可能。

因此,內容審核員在未來很長一段時間內都不會消失。

在這漫長的未來中,可以預見的是,隨著資訊傳播量越來越大,圖片影片樣式不斷翻新,內容審核員也只會被繼續要求審查更高標準的、具有細微差別的違禁內容。

▲ 圖片來自:CONTENTBOT.NET

只是未來,網路環境也不一定就會更「綠色健康」。

無法消失的網路黃暴恐

和內容審核員一樣,黃暴恐可能也會一直在網上「存活」。

在這個比以往更容易自由表達的當下,人人發出自我的聲音,但這份自由屬於所有人,我們很難保證別人的自由不會傷害到我們自身,這是必然會產生的代價。

▲ 圖片來自:SETH LAUPUS

同時,隨著網路內容產業的競爭進入下半場,各家的流量之爭也越發激烈。

每個平台的內容審核員,除了刪除違禁內容,也會有意識地只放對平台有利的內容,從而打造出自己平台獨特的品牌風格,這也是品牌保護的一種形式。

但所有平台共同的一點是:它們都需要靠用戶的注意力存活下去。

▲ 圖片來自:SHUTTERSTOCK

為了讓用戶不斷上癮,這些公司就會通過越加精準的數據算法加上人工挑選,讓人們在平台上停留更久時間,讓人們越想看的越呈現,但:黃、暴、恐恰恰就是人性慾望之所在。

在一個又一個網路熱點中,已經可以看出,人性本能就喜歡不斷刷新底線的、挑戰禁忌的、煽動對立的、製造憤怒的內容,恰恰社交平台卻想要保持綠色健康美好光明的環境——這是個永遠無法解決的矛盾。

▲ 圖片來自:《網路清道夫》截圖

在這種衝突之下,各大平台似乎只能險中求穩。

對網友來說,儘管我們看到的內容,是被選擇過的,或者被定製過的,而且它會讓我們無法認識深層的醜惡真相,但更重要的是我們在任何情況下,都具有批判和思考的能力。

比起讓無底線的霸凌、犯罪、羞辱、反動遍布全網,把災難的火苗在源頭掐滅,總歸來說利大於弊。

內容審核員無法消失,「黃暴恐」也無法消失,我們只能讓技術更加先進,讓規則更加清晰,不然網路可能會朝著無法回頭的極端走去。

▲ 圖片來自:TIN VARSAVSKY/FLICKR

但無論什麼情況下,對我們而言最重要的,正如祖克伯在一次發表會上所說:

我們需要勇氣去選擇希望而非恐懼,去宣示我們能讓世界變得更美好。我們必須保持樂觀,正是這份希望和這份樂觀促成了一個個偉大的進步。更重要的是,我們需要共同努力。

畢竟對比現實的深淵,內容審核員看到的殘酷萬象,也只是冰山一角。

(原文刊登於愛范兒,蘋果仁授權轉載)